За последние несколько десятилетий ученые-компьютерщики разработали все более совершенные методы обучения и эксплуатации роботов. В совокупности эти методы могут облегчить интеграцию роботизированных систем во все более широкий спектр реальных условий.

Исследователи из Университета Карнеги-Меллона недавно создали новую систему, которая позволяет пользователям дистанционно управлять роботизированной рукой , просто демонстрируя перед камерой движения, которые они хотят воспроизвести. Эта система, представленная в статье, предварительно опубликованной на arXiv, может открыть захватывающие возможности для дистанционного управления и дистанционного обучения роботов, выполняющих миссии как в повседневных условиях, так и в средах, недоступных для человека.

«Предыдущие работы в этой области основывались либо на перчатках, маркерах движения, либо на откалиброванной многокамерной установке», — сказал TechXplore Дипак Патхак, один из исследователей, разработавших новую систему. «Вместо этого наша система работает с использованием одной некалиброванной камеры. Поскольку калибровка не требуется, пользователь может стоять где угодно и при этом успешно управлять роботом».

Новая система, разработанная Патаком и его коллегами, основана на модели, которая может преобразовывать движения человеческих рук в серию инструкций, которые затем направляют движения робота. Примечательно, что модель была обучена исключительно на серии видеороликов YouTube, в которых люди выполняют действия и взаимодействуют с различными объектами.

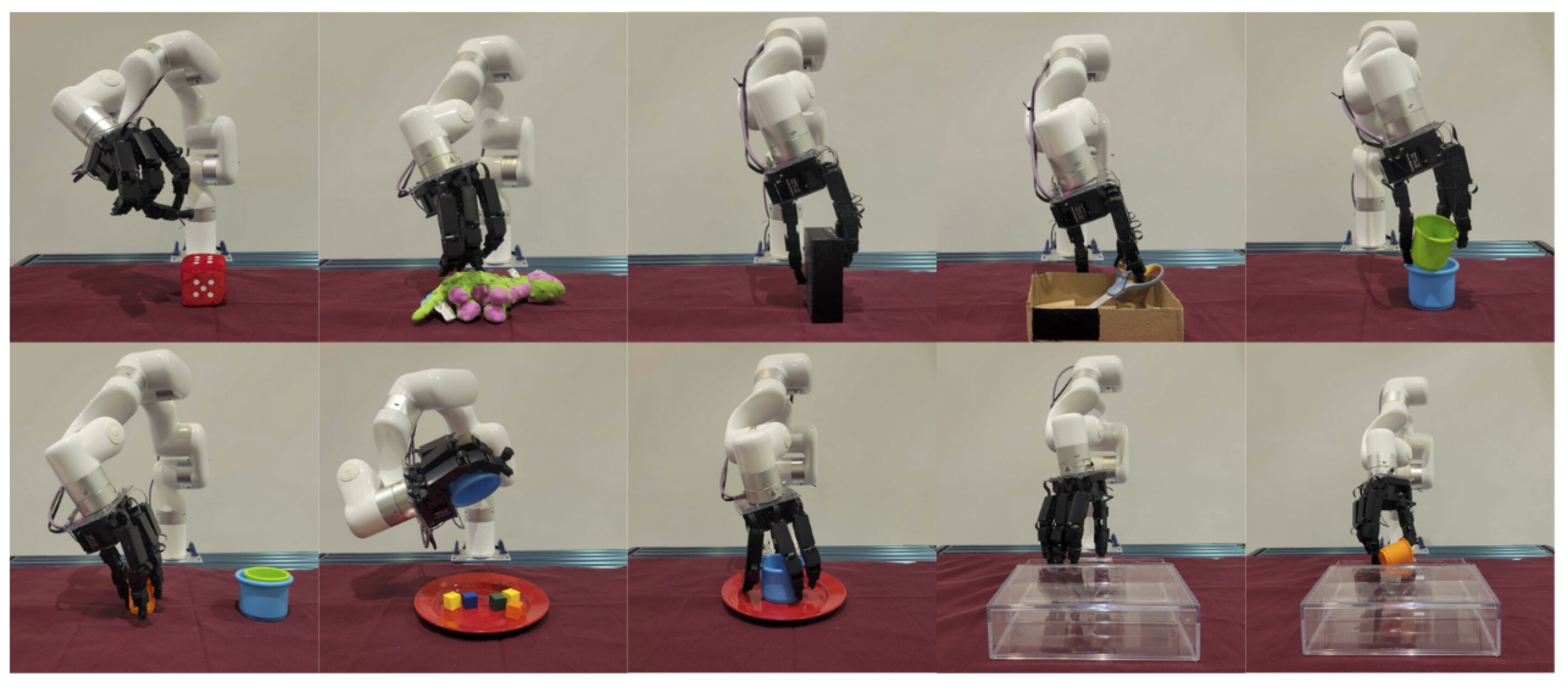

Робот выполняет различные ловкие задачи, дистанционно управляемые опытным оператором с помощью роботизированной системы телекинеза.

«Разнообразие огромных пассивных видеоданных помогает ему работать с неподготовленными пользователями, задачами и объектами», — пояснил Патхак. «Наша система предлагает недорогой и естественный способ обучения роботов с помощью демонстраций, в отличие от кинестетического удерживания робота или ношения перчаток или костюма захвата движения».

Анализируя одно двумерное (2D) изображение, система исследователей может определить движения, которые человеческая рука выполняют в трехмерном (3D) пространстве. Впоследствии система перенацеливает суставы рук человека, чтобы они соответствовали суставам рук робота, чтобы воспроизвести те же движения.

Чтобы обучить свою систему исключительно с использованием пассивных видеоданных, исследователи опирались на десятилетия исследований, посвященных трехмерной оценке позы человека и компьютерному зрению. Их первоначальные результаты весьма многообещающие, поскольку они обнаружили, что их система может позволить неподготовленным пользователям дистанционно управлять роботом и удаленно выполнять различные ловкие манипуляционные задачи.

«Лично для меня самой интересной частью является использование разнообразных интернет-данных для робототехники», — сказал Патхак. «Надеюсь, наша недавняя работа — лишь одно из многих будущих направлений, в которых интернет-видео выступает в качестве богатого источника наблюдения за роботизированным управлением в дополнение к роботизированному зрению».

Чтобы использовать систему, разработанную этой группой исследователей, пользователям просто нужно встать перед RGB-камерой и выполнить движения руки, которые они хотели бы, чтобы робот воспроизвел. Поскольку она очень проста в использовании и не требует сложного оборудования, система в конечном итоге может быть использована для решения множества реальных проблем.

«Роботизированный телекинез и аналогичные технологии позволят обучать роботов в самых разных условиях, в том числе в домашних условиях, где они будут выполнять повседневные задачи. Патхак добавил: «Используя только одну некалиброванную камеру, наша система теоретически может управляться из в любой точке мира, что делает обучение роботов более доступным для всех. Сейчас мы собираем крупномасштабные данные, используя нашу роботизированную систему телекинеза, чтобы научить робота действовать и адаптироваться автономно в реальном мире».

Дополнительная информация: Аравинд Сивакумар, Кеннет Шоу, Дипак Патхак, Роботизированный телекинез: изучение роботизированного имитатора руки, наблюдая за людьми на Youtube. arXiv:2202.10448v1 [cs.RO], arxiv.org/abs/2202.10448

Изображения: Sivakumar, Shaw & Pathak.

Будьте в курсе в удобном формате, присоединяйтесь: TG-канал и ВК

Бесплатная служба распространения новостей для научных организаций и стартапов

hello@technovery.com

Платформа

Платформа Добавить публикацию

Добавить публикацию Реклама

Реклама Центр инноваций

Центр инноваций Партнеры

Партнеры hello@technovery.com

hello@technovery.com telegram

telegram